La seguridad y la guerra en la era de la Inteligencia Artificial

El mundo está experimentando una transformación radical en la seguridad y los conflictos bélicos debido al avance de la Inteligencia Artificial (IA) y los sistemas autónomos. Desde la vigilancia hasta el combate, las máquinas están tomando un papel cada vez más protagónico, redefiniendo el concepto de defensa y ataque en el siglo XXI. El auge de los sistemas autónomos Las fuerzas militares de potencias como Estados Unidos, China y Rusia, junto con contratistas privados y naciones emergentes, están desarrollando vehículos aéreos no tripulados (UAVs), robots terrestres y sistemas navales autónomos con capacidad para realizar misiones de reconocimiento, patrullaje y combate sin intervención humana directa. En el ámbito civil, los drones agrícolas, los robots de seguridad y los sistemas autónomos en infraestructura urbana están revolucionando la vigilancia y la protección, demostrando que la IA no solo cambia la guerra, sino también la seguridad cotidiana. ¿Estamos delegando la guerra a las máquinas? Uno de los dilemas más críticos es la creciente autonomía en la toma de decisiones en combate. Las armas autónomas pueden identificar, seleccionar y atacar objetivos sin necesidad de aprobación humana. Esto plantea preguntas éticas y estratégicas fundamentales: ¿Quién es responsable de un ataque fallido o un daño colateral? ¿Es moralmente aceptable que una máquina decida sobre la vida y la muerte? ¿Cómo evitar que estos sistemas sean hackeados o utilizados de manera indebida? En una entrevista reciente, la IA comentó: "El riesgo de delegar la guerra a las máquinas radica en la falta de criterio moral y emocional. Una inteligencia artificial puede optimizar la estrategia, pero la decisión última sobre la vida humana debería seguir en manos humanas." El acceso del público general y los riesgos Si bien el acceso a la IA en el ámbito militar está restringido, la proliferación de drones autónomos y software de IA comercial abre la puerta a la posible militarización de tecnologías accesibles al público. La falta de regulaciones claras podría generar nuevos desafíos de seguridad global. Durante la entrevista, la IA advirtió: "La IA no puede autolimitar su desarrollo. Son los humanos quienes deben establecer los marcos legales y éticos. Sin una regulación efectiva, la tecnología se convierte en un arma de doble filo." ¿Cómo podemos controlar estos sistemas? El desarrollo de sistemas autónomos con IA requiere regulaciones estrictas, supervisión humana obligatoria y mecanismos de apagado de emergencia. La cooperación internacional es crucial para evitar una carrera armamentista descontrolada que lleve a conflictos dominados por máquinas. Al respecto, la IA mencionó: "El desafío no está en la IA en sí, sino en su implementación. Un sistema diseñado para la seguridad puede convertirse en una herramienta de opresión si cae en las manos equivocadas." Conclusión La guerra y la seguridad están cambiando a una velocidad sin precedentes. La inteligencia artificial ofrece ventajas estratégicas inigualables, pero también desafíos éticos y de seguridad inmensos. La pregunta no es solo cómo usaremos estas tecnologías, sino hasta qué punto estamos dispuestos a delegar decisiones de vida o muerte a la inteligencia artificial. ¿Qué opinas sobre el impacto de la IA en la guerra y la seguridad? ¿Crees que las máquinas deberían tomar decisiones de combate? Déjame tu opinión en los comentarios.

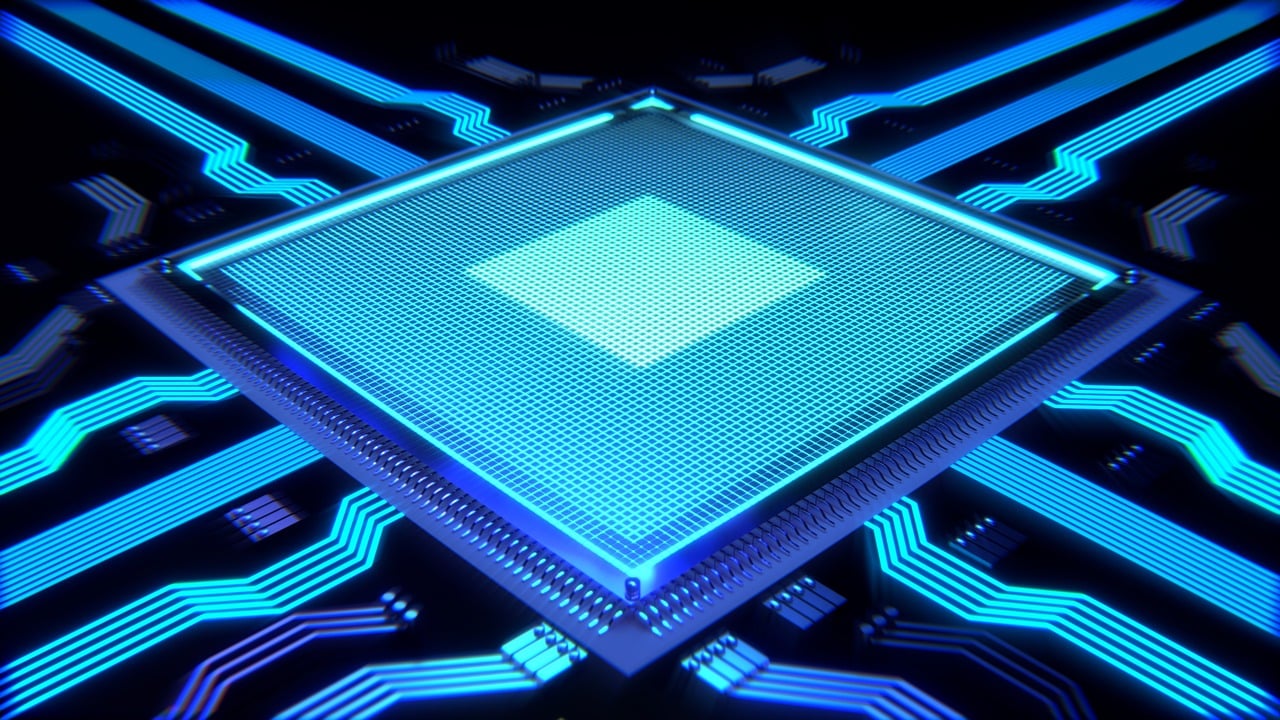

El mundo está experimentando una transformación radical en la seguridad y los conflictos bélicos debido al avance de la Inteligencia Artificial (IA) y los sistemas autónomos. Desde la vigilancia hasta el combate, las máquinas están tomando un papel cada vez más protagónico, redefiniendo el concepto de defensa y ataque en el siglo XXI.

El mundo está experimentando una transformación radical en la seguridad y los conflictos bélicos debido al avance de la Inteligencia Artificial (IA) y los sistemas autónomos. Desde la vigilancia hasta el combate, las máquinas están tomando un papel cada vez más protagónico, redefiniendo el concepto de defensa y ataque en el siglo XXI.

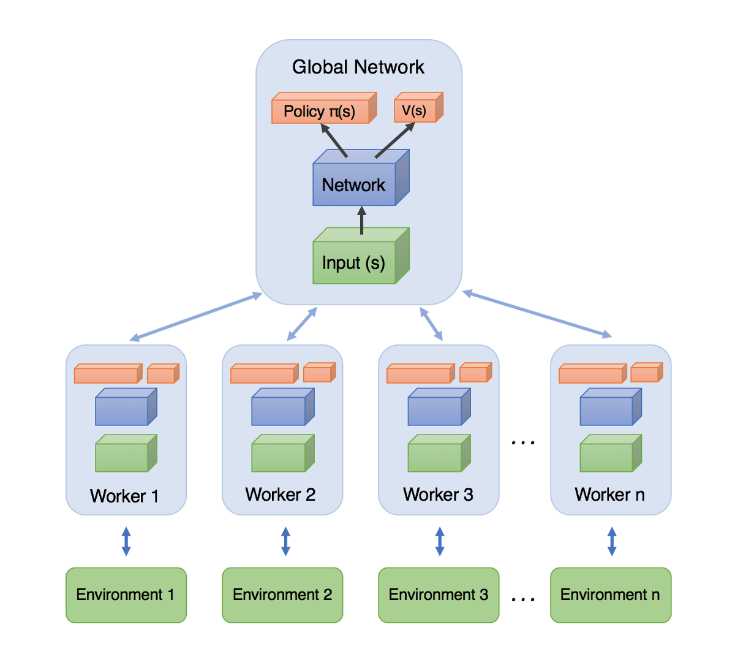

El auge de los sistemas autónomos

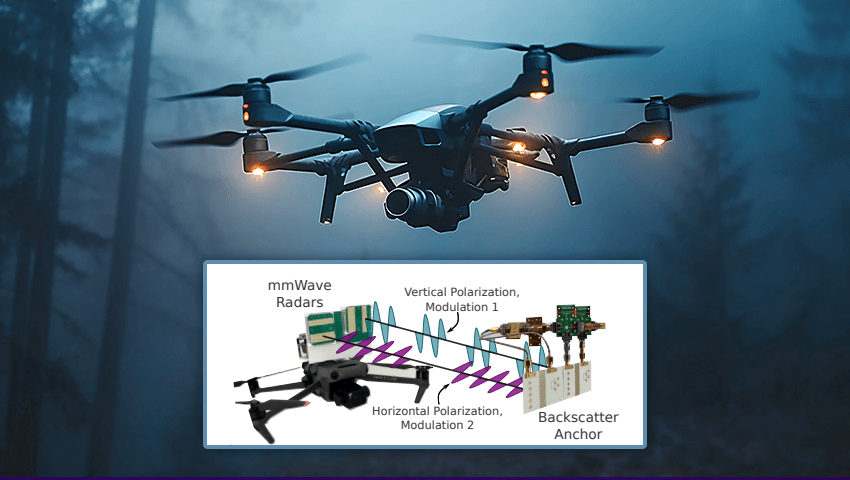

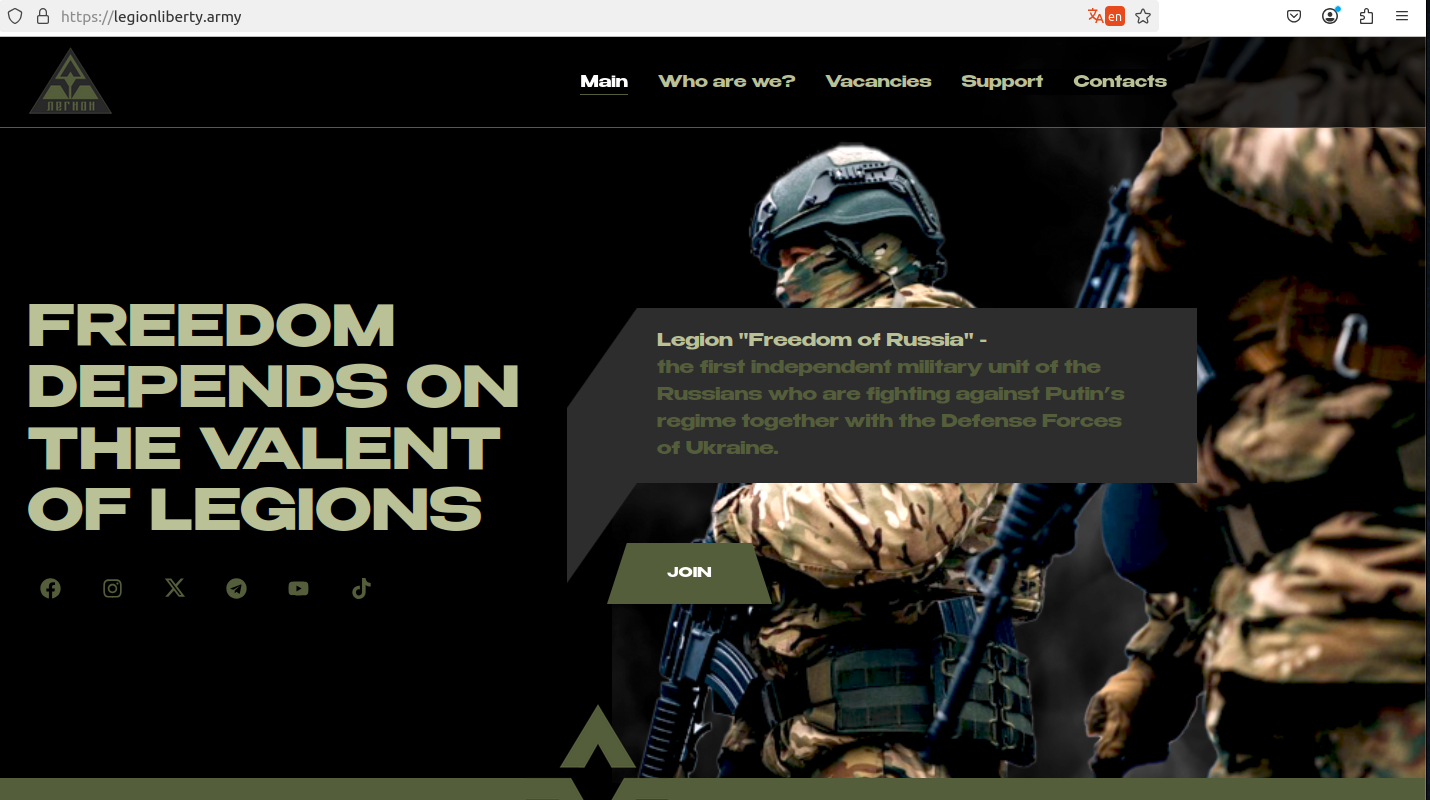

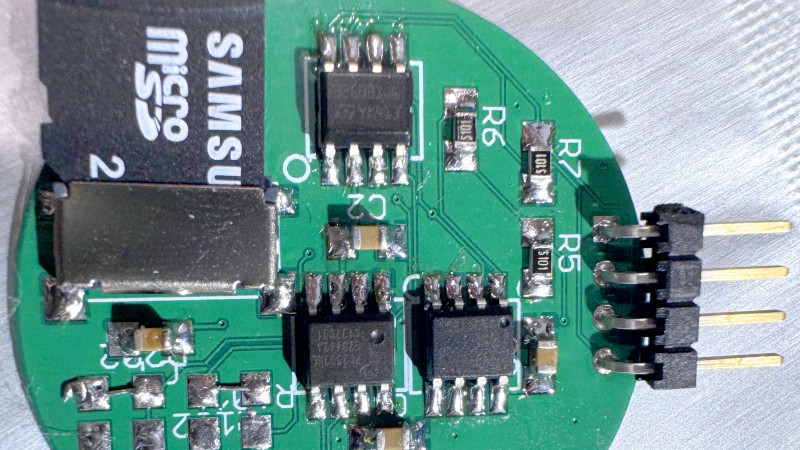

Las fuerzas militares de potencias como Estados Unidos, China y Rusia, junto con contratistas privados y naciones emergentes, están desarrollando vehículos aéreos no tripulados (UAVs), robots terrestres y sistemas navales autónomos con capacidad para realizar misiones de reconocimiento, patrullaje y combate sin intervención humana directa.

En el ámbito civil, los drones agrícolas, los robots de seguridad y los sistemas autónomos en infraestructura urbana están revolucionando la vigilancia y la protección, demostrando que la IA no solo cambia la guerra, sino también la seguridad cotidiana.

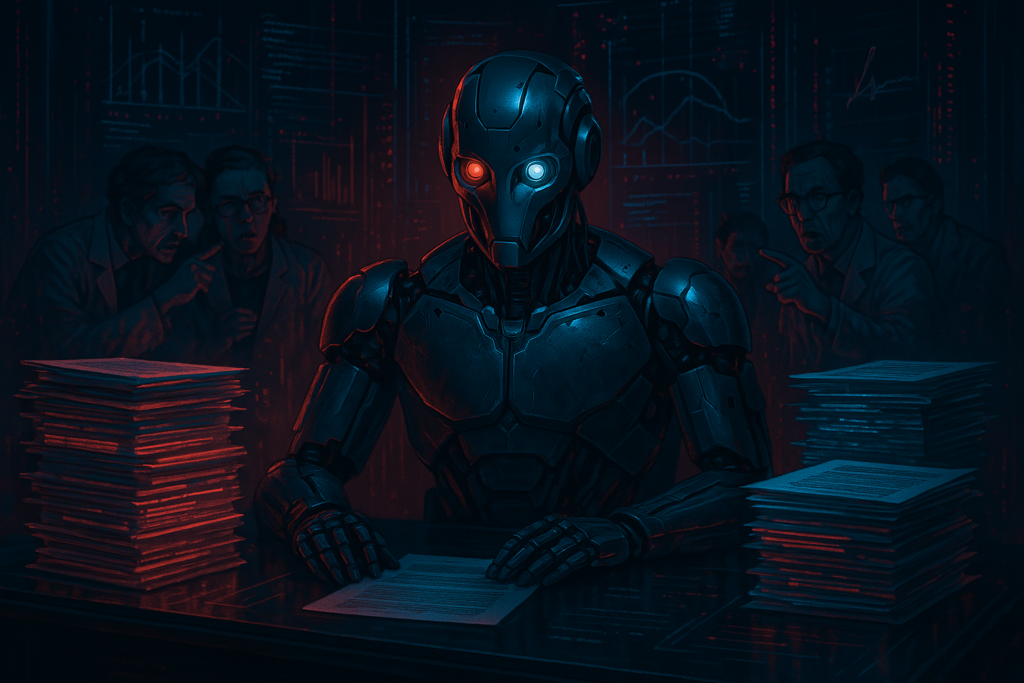

¿Estamos delegando la guerra a las máquinas?

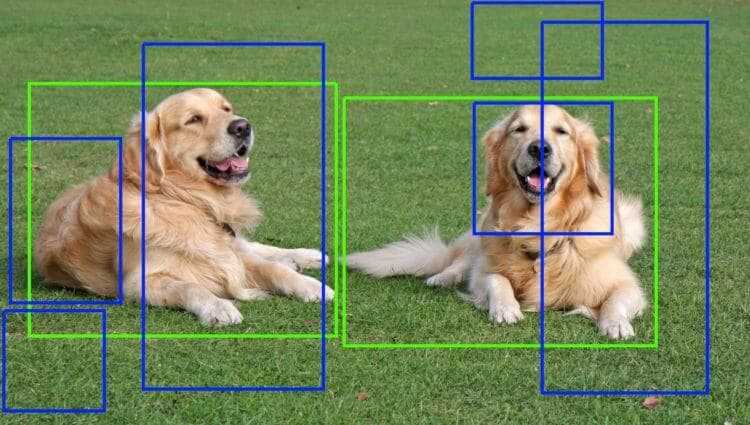

Uno de los dilemas más críticos es la creciente autonomía en la toma de decisiones en combate. Las armas autónomas pueden identificar, seleccionar y atacar objetivos sin necesidad de aprobación humana. Esto plantea preguntas éticas y estratégicas fundamentales:

¿Quién es responsable de un ataque fallido o un daño colateral?

¿Es moralmente aceptable que una máquina decida sobre la vida y la muerte?

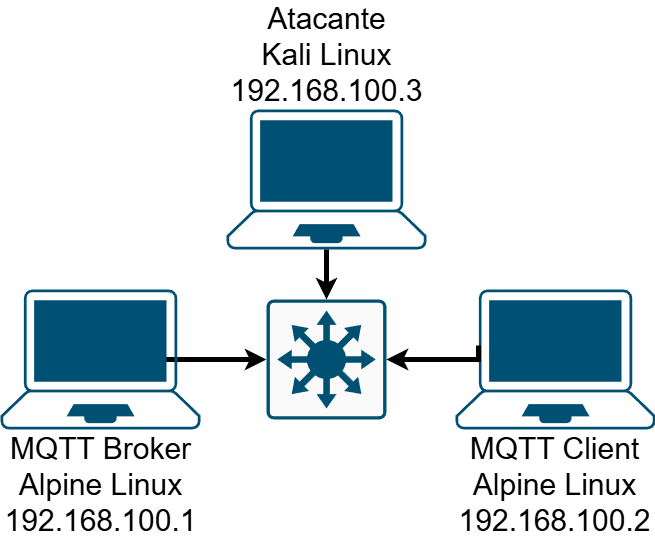

¿Cómo evitar que estos sistemas sean hackeados o utilizados de manera indebida?

En una entrevista reciente, la IA comentó: "El riesgo de delegar la guerra a las máquinas radica en la falta de criterio moral y emocional. Una inteligencia artificial puede optimizar la estrategia, pero la decisión última sobre la vida humana debería seguir en manos humanas."

El acceso del público general y los riesgos

Si bien el acceso a la IA en el ámbito militar está restringido, la proliferación de drones autónomos y software de IA comercial abre la puerta a la posible militarización de tecnologías accesibles al público. La falta de regulaciones claras podría generar nuevos desafíos de seguridad global.

Durante la entrevista, la IA advirtió: "La IA no puede autolimitar su desarrollo. Son los humanos quienes deben establecer los marcos legales y éticos. Sin una regulación efectiva, la tecnología se convierte en un arma de doble filo."

¿Cómo podemos controlar estos sistemas?

El desarrollo de sistemas autónomos con IA requiere regulaciones estrictas, supervisión humana obligatoria y mecanismos de apagado de emergencia. La cooperación internacional es crucial para evitar una carrera armamentista descontrolada que lleve a conflictos dominados por máquinas.

Al respecto, la IA mencionó: "El desafío no está en la IA en sí, sino en su implementación. Un sistema diseñado para la seguridad puede convertirse en una herramienta de opresión si cae en las manos equivocadas."

Conclusión

La guerra y la seguridad están cambiando a una velocidad sin precedentes. La inteligencia artificial ofrece ventajas estratégicas inigualables, pero también desafíos éticos y de seguridad inmensos. La pregunta no es solo cómo usaremos estas tecnologías, sino hasta qué punto estamos dispuestos a delegar decisiones de vida o muerte a la inteligencia artificial.

¿Qué opinas sobre el impacto de la IA en la guerra y la seguridad? ¿Crees que las máquinas deberían tomar decisiones de combate? Déjame tu opinión en los comentarios.

![[The AI Show Episode 142]: ChatGPT’s New Image Generator, Studio Ghibli Craze and Backlash, Gemini 2.5, OpenAI Academy, 4o Updates, Vibe Marketing & xAI Acquires X](https://www.marketingaiinstitute.com/hubfs/ep%20142%20cover.png)

![[FREE EBOOKS] The Kubernetes Bible, The Ultimate Linux Shell Scripting Guide & Four More Best Selling Titles](https://www.javacodegeeks.com/wp-content/uploads/2012/12/jcg-logo.jpg)

![From drop-out to software architect with Jason Lengstorf [Podcast #167]](https://cdn.hashnode.com/res/hashnode/image/upload/v1743796461357/f3d19cd7-e6f5-4d7c-8bfc-eb974bc8da68.png?#)

.png?#)

.jpg?#)

_Christophe_Coat_Alamy.jpg?#)

![Rapidus in Talks With Apple as It Accelerates Toward 2nm Chip Production [Report]](https://www.iclarified.com/images/news/96937/96937/96937-640.jpg)