Search-o1: Agentic Search-Enhanced Large Reasoning Models

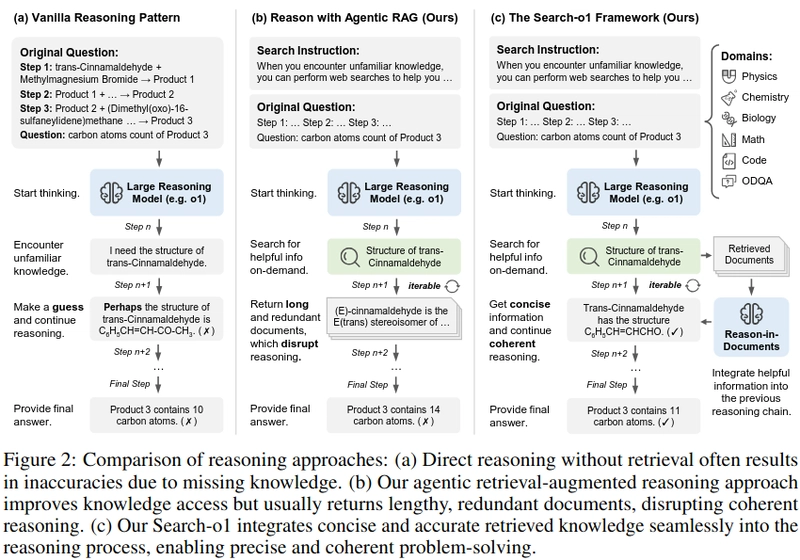

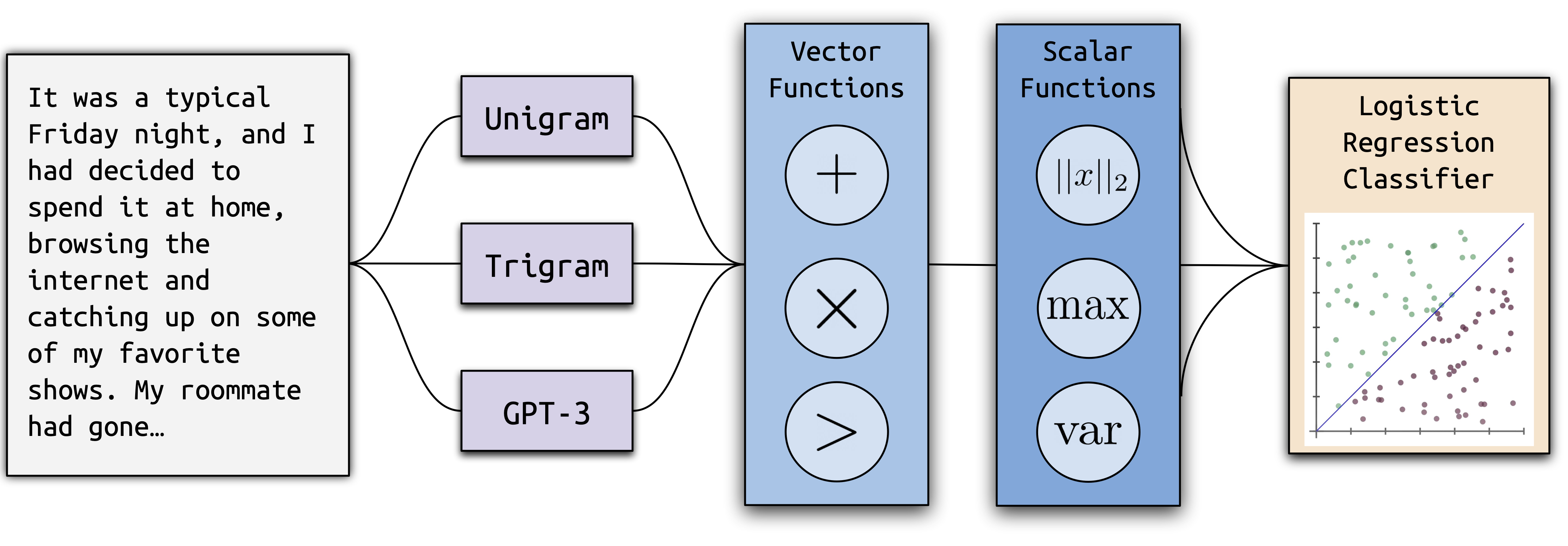

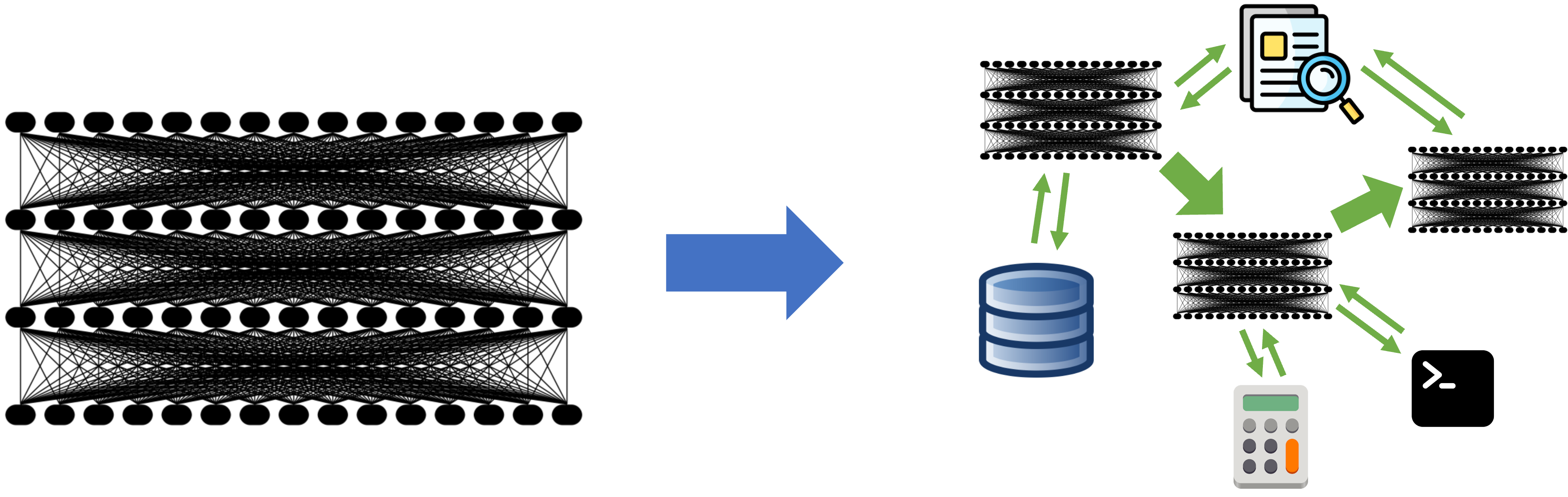

選定理由と所感 Tsinghua Universityの研究、OpenAIのDeepResearchの方式はブラックボックスであるが、耐ノイズRAGという分野は今後も大きな研究分野になると思われる。 Paper: https://arxiv.org/abs/2501.05366 Code: N/A agentic RAGの弱点を補うためのReason-in-Documentsを追加して耐ノイズ性能を高めている。Reason-in-Documentsのロジックを数式にすると複雑に見えるが、やっていることはLLM頼みで難しくはない。 概要 【社会課題】 LLMは膨大な知識を学習できるが、ビジネスは常に変化し続けるためLLMが持っていない知識が重要となる場面が多い。 【技術課題】 RAG は 1 回の検索で全ての知識を補おうとするため、推論の各ステップで必要な異なる情報を得られない。また、長文の検索結果はモデルの推論の一貫性を損ない、誤答の原因となる。さらにLLMs は長文理解が苦手であり、適切な情報抽出が困難。 【提案】 提案するSearch-o1 は Agentic RAG で推論中に必要なタイミングで検索を行い、Reason-in-Documents モジュール で検索結果を整理して推論の一貫性を維持する。これにより、LRMs の知識補完と推論精度を向上させる。 【実験・効果】 科学・数学・コーディング・QA などのタスクで評価した結果、Search-o1 は GPQA で専門家を上回る精度を達成し、従来の RAG に比べ最大 29.6% 精度が向上。特に多段階推論が必要な問題で大きな効果を発揮した。 Search-o1 Search-o1 Inference Process 動的な知識補完と推論最適化を組み合わせた推論プロセスであり、以下の 3 つの主要ステップで構成される。 1* オンデマンド検索による知識補完(Agentic RAG) 2* Reason-in-Documents による情報整理 3* Batch Inference Mechanism による推論最適化 Agentic Retrieval-Augmented Generation Mechanism 従来のRAGは 1 回の検索で取得されたデータを元に推論を行うが、Agentic RAGでは推論の各ステップでオンデマンドで検索を実行し、逐次的に知識補完する。これにより、必要な情報を逐一取得できるため、推論精度が向上する。また、検索クエリの生成もモデル自身が適応的に決定し、推論の文脈に基づいた柔軟な情報取得を可能にする。 ただし、Agentic RAGは取得された文書をそのままプロンプトに挿入するため、ノイズ・冗長性を増加させる欠点があった。又、開発時のアルゴリズムも複雑になりがちである。 Knowledge Refinement via Reason-in-Documents search-o1最大の特徴となる検索から必要な情報だけを抽出し、統合するための処理を行う部。これによってAgentic RAGが持つ欠点を補うことができる。 1 検索結果のフィルタリング 取得したドキュメントから 推論に直接関係しない情報を除去する。例えば、数式の証明を求める場合、定義の説明は必要だが、歴史的背景は不要。 2 関連情報の抽出と再構成 検索結果を LLM に適したフォーマットで整理し、必要な情報のみを統合する。例えば、同じ概念について異なる文書で説明されている場合、それらを要約・統合してLLMに提供。 3 推論コンテキストの最適化 LLMの推論がスムーズに行えるよう、整理された情報を適切な文脈で提示する。コーディングタスクなら、コードスニペットとその説明を 最適な順序で配置し、理解しやすくする。 Batch Inference Mechanism 複数の推論リクエストを一括処理することで、計算コストを削減しつつ推論の一貫性を向上させる手法も提案している。具体的には、類似したクエリを統合し、冗長な検索を省略することで、必要な知識を効率的に取得・整理する。さらに、並列推論を活用することで処理速度を向上させ、従来の逐次的な検索・推論に比べて大幅なパフォーマンス改善を実現する。 実験 実験では、科学、数学、プログラミング などの推論タスクを対象に、Search-o1 の性能を評価した。従来の RAG と比較し、正答率の向上、推論の一貫性、検索効率の改善 を確認。特に、Agentic RAG による動的検索と Reason-in-Documents による情報整理が有効であり、長文推論や複雑な問題でのパフォーマンスが向上した。また、Batch Inference Mechanism により、検索・推論コストの削減 も達成された。

選定理由と所感

Tsinghua Universityの研究、OpenAIのDeepResearchの方式はブラックボックスであるが、耐ノイズRAGという分野は今後も大きな研究分野になると思われる。

Paper: https://arxiv.org/abs/2501.05366

Code: N/A

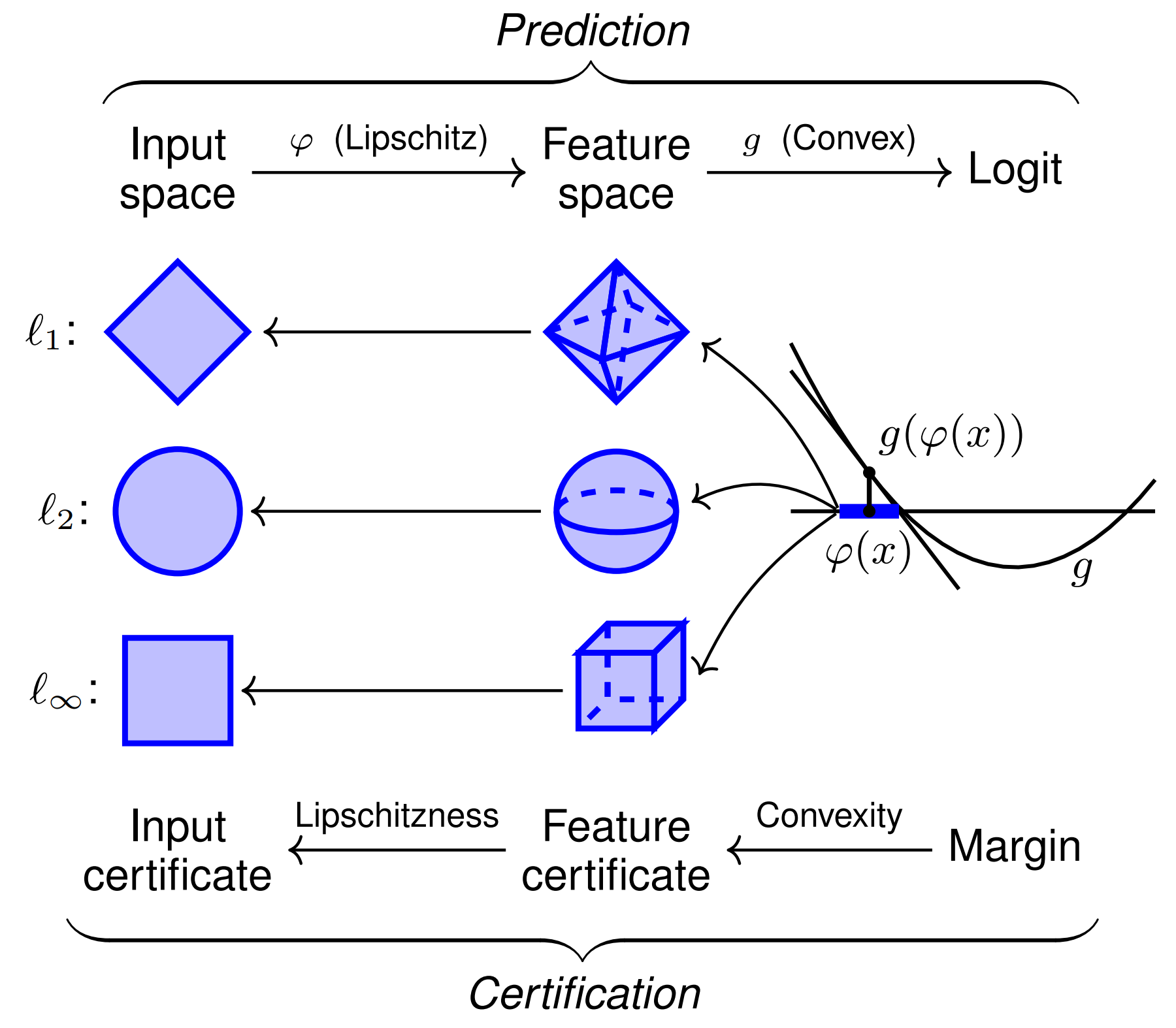

agentic RAGの弱点を補うためのReason-in-Documentsを追加して耐ノイズ性能を高めている。Reason-in-Documentsのロジックを数式にすると複雑に見えるが、やっていることはLLM頼みで難しくはない。

概要

【社会課題】

LLMは膨大な知識を学習できるが、ビジネスは常に変化し続けるためLLMが持っていない知識が重要となる場面が多い。

【技術課題】

RAG は 1 回の検索で全ての知識を補おうとするため、推論の各ステップで必要な異なる情報を得られない。また、長文の検索結果はモデルの推論の一貫性を損ない、誤答の原因となる。さらにLLMs は長文理解が苦手であり、適切な情報抽出が困難。

【提案】

提案するSearch-o1 は Agentic RAG で推論中に必要なタイミングで検索を行い、Reason-in-Documents モジュール で検索結果を整理して推論の一貫性を維持する。これにより、LRMs の知識補完と推論精度を向上させる。

【実験・効果】

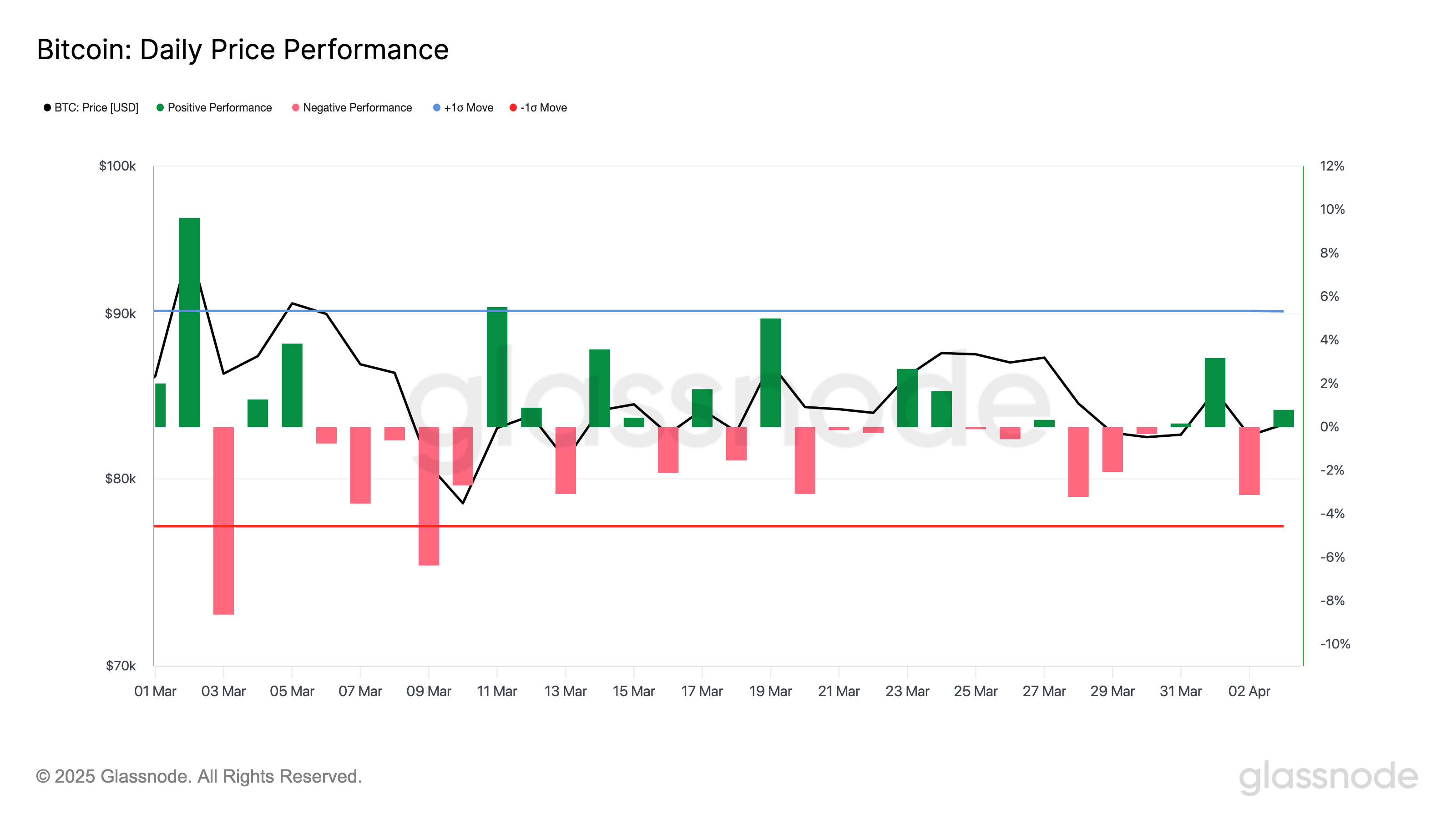

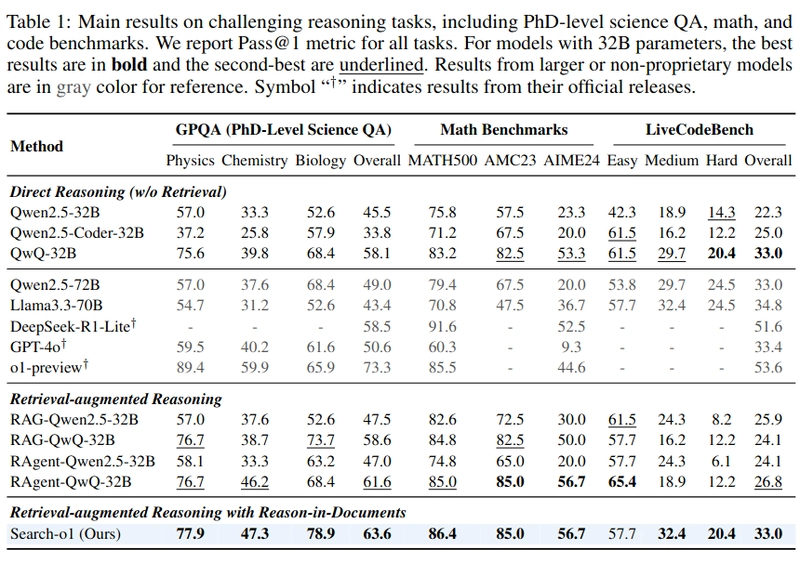

科学・数学・コーディング・QA などのタスクで評価した結果、Search-o1 は GPQA で専門家を上回る精度を達成し、従来の RAG に比べ最大 29.6% 精度が向上。特に多段階推論が必要な問題で大きな効果を発揮した。

Search-o1

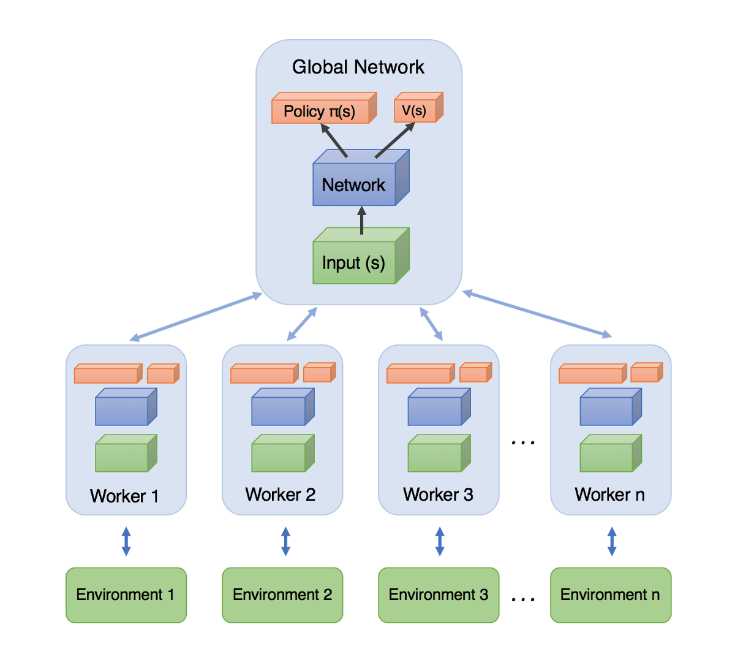

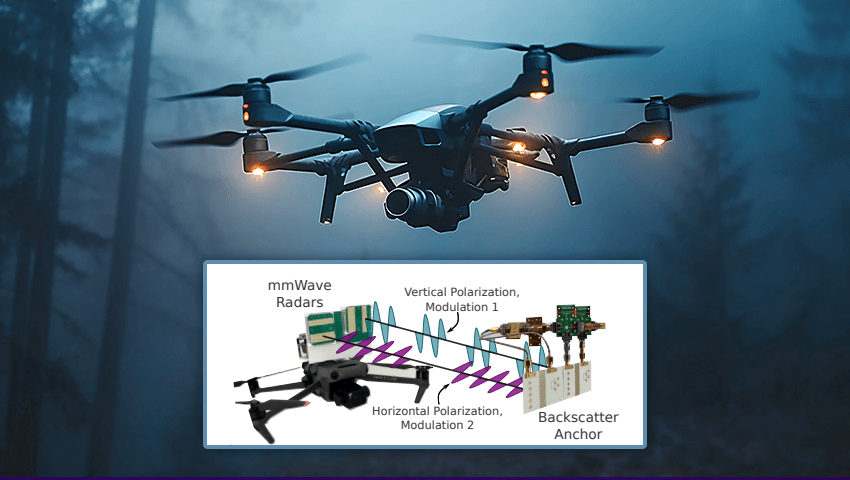

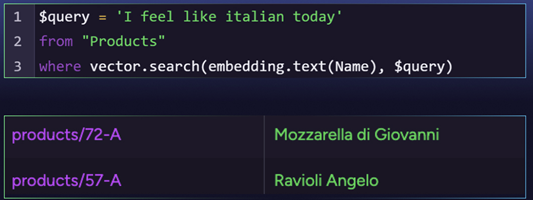

Search-o1 Inference Process

動的な知識補完と推論最適化を組み合わせた推論プロセスであり、以下の 3 つの主要ステップで構成される。

1* オンデマンド検索による知識補完(Agentic RAG)

2* Reason-in-Documents による情報整理

3* Batch Inference Mechanism による推論最適化

Agentic Retrieval-Augmented Generation Mechanism

従来のRAGは 1 回の検索で取得されたデータを元に推論を行うが、Agentic RAGでは推論の各ステップでオンデマンドで検索を実行し、逐次的に知識補完する。これにより、必要な情報を逐一取得できるため、推論精度が向上する。また、検索クエリの生成もモデル自身が適応的に決定し、推論の文脈に基づいた柔軟な情報取得を可能にする。

ただし、Agentic RAGは取得された文書をそのままプロンプトに挿入するため、ノイズ・冗長性を増加させる欠点があった。又、開発時のアルゴリズムも複雑になりがちである。

Knowledge Refinement via Reason-in-Documents

search-o1最大の特徴となる検索から必要な情報だけを抽出し、統合するための処理を行う部。これによってAgentic RAGが持つ欠点を補うことができる。

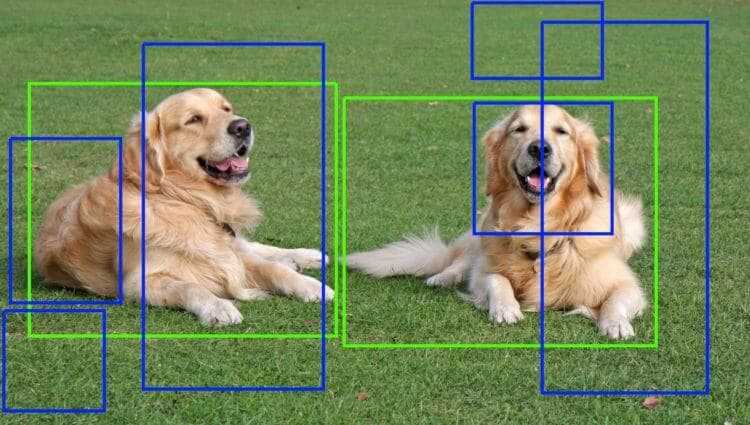

1 検索結果のフィルタリング

取得したドキュメントから 推論に直接関係しない情報を除去する。例えば、数式の証明を求める場合、定義の説明は必要だが、歴史的背景は不要。

2 関連情報の抽出と再構成

検索結果を LLM に適したフォーマットで整理し、必要な情報のみを統合する。例えば、同じ概念について異なる文書で説明されている場合、それらを要約・統合してLLMに提供。

3 推論コンテキストの最適化

LLMの推論がスムーズに行えるよう、整理された情報を適切な文脈で提示する。コーディングタスクなら、コードスニペットとその説明を 最適な順序で配置し、理解しやすくする。

Batch Inference Mechanism

複数の推論リクエストを一括処理することで、計算コストを削減しつつ推論の一貫性を向上させる手法も提案している。具体的には、類似したクエリを統合し、冗長な検索を省略することで、必要な知識を効率的に取得・整理する。さらに、並列推論を活用することで処理速度を向上させ、従来の逐次的な検索・推論に比べて大幅なパフォーマンス改善を実現する。

実験

実験では、科学、数学、プログラミング などの推論タスクを対象に、Search-o1 の性能を評価した。従来の RAG と比較し、正答率の向上、推論の一貫性、検索効率の改善 を確認。特に、Agentic RAG による動的検索と Reason-in-Documents による情報整理が有効であり、長文推論や複雑な問題でのパフォーマンスが向上した。また、Batch Inference Mechanism により、検索・推論コストの削減 も達成された。

![[The AI Show Episode 142]: ChatGPT’s New Image Generator, Studio Ghibli Craze and Backlash, Gemini 2.5, OpenAI Academy, 4o Updates, Vibe Marketing & xAI Acquires X](https://www.marketingaiinstitute.com/hubfs/ep%20142%20cover.png)

.jpg?#)

![YouTube Announces New Creation Tools for Shorts [Video]](https://www.iclarified.com/images/news/96923/96923/96923-640.jpg)

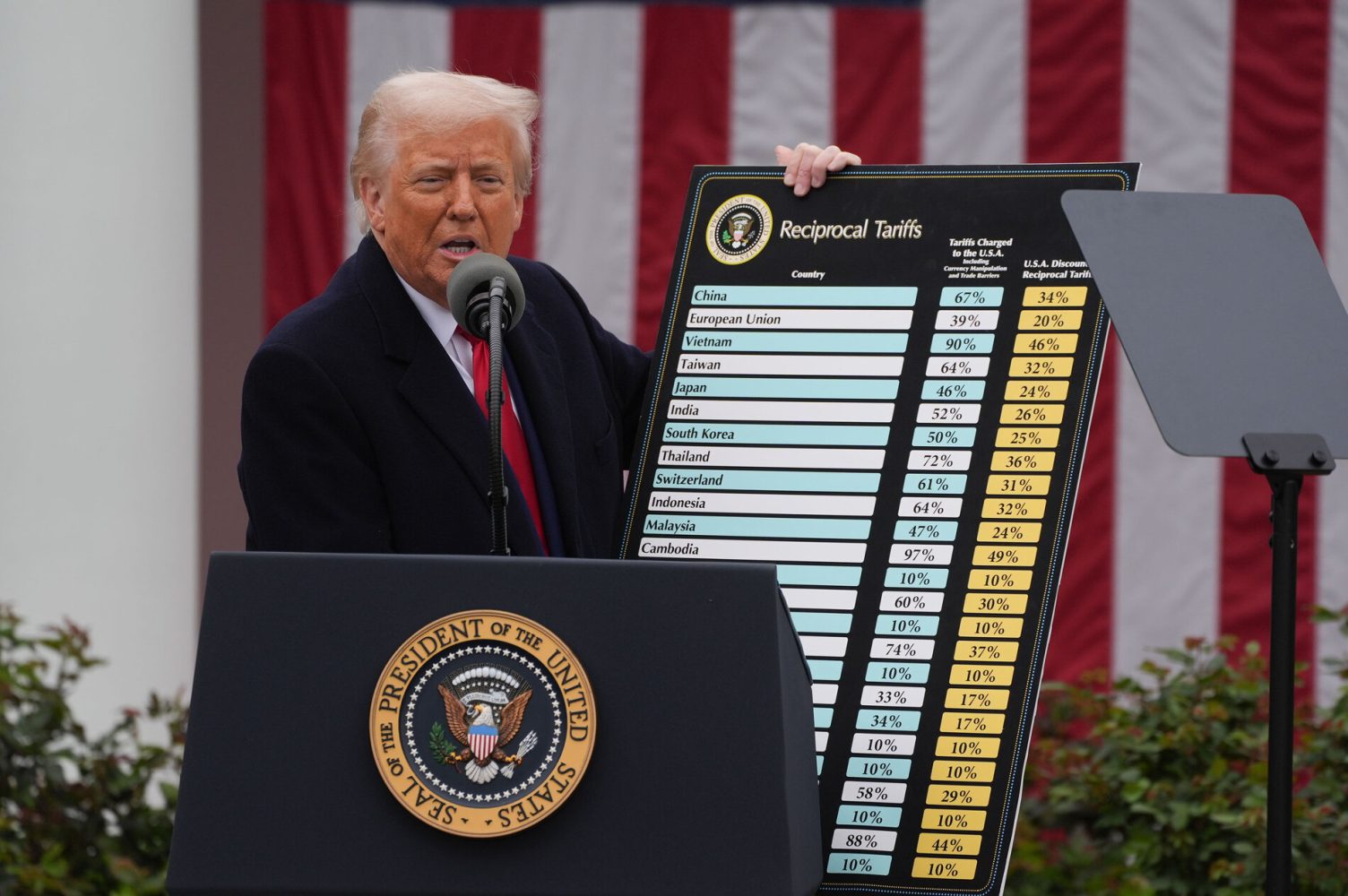

![Apple Faces New Tariffs but Has Options to Soften the Blow [Kuo]](https://www.iclarified.com/images/news/96921/96921/96921-640.jpg)