Введение в пакетную обработку и Spark

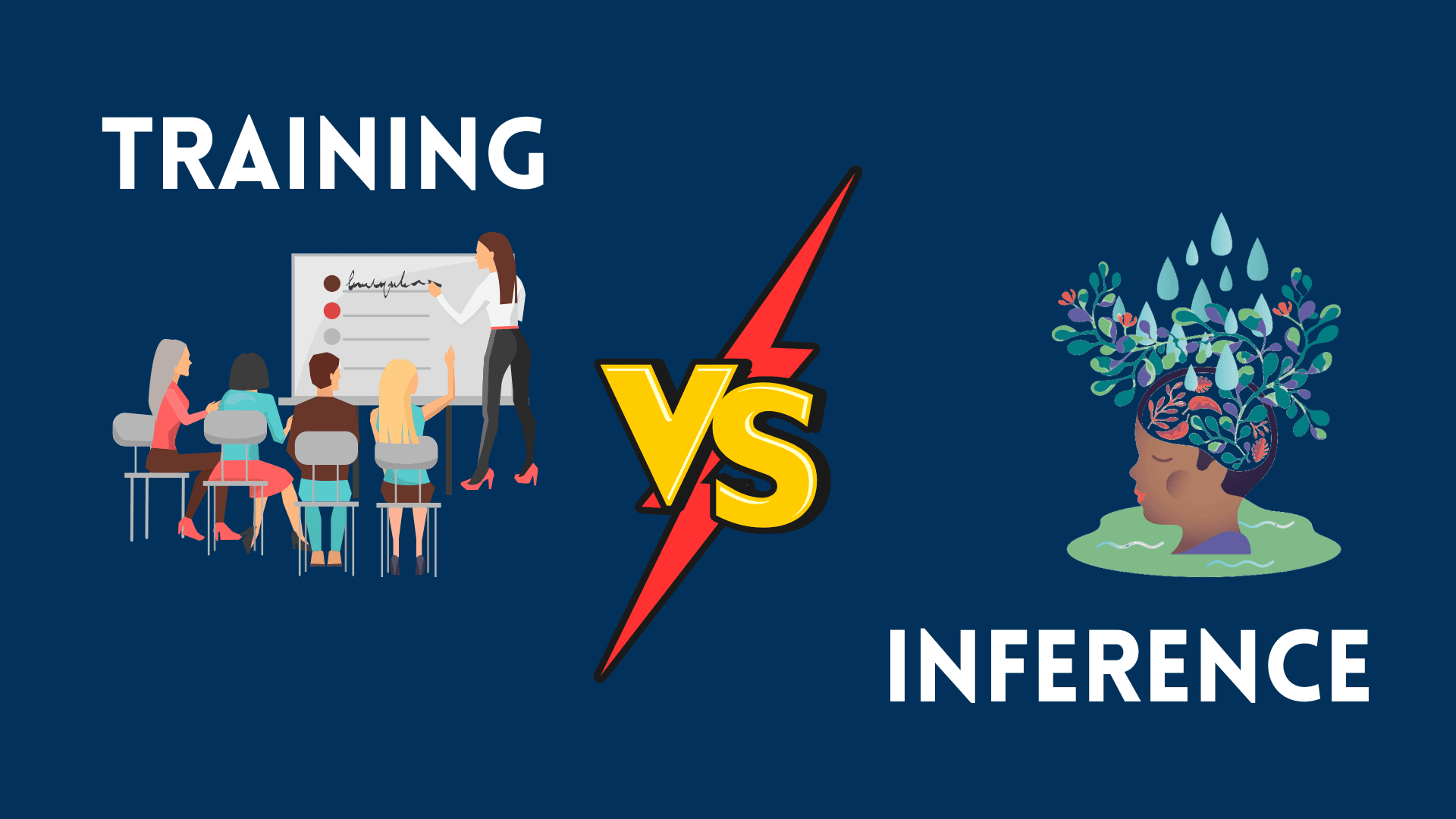

1. Введение в пакетную обработку (Batch Processing) Что такое пакетная обработка? Пакетная обработка (Batch Processing) — это метод обработки данных большими порциями в запланированные интервалы времени. Этот подход широко применяется в data engineering для эффективной обработки больших объемов данных. Batch-задания обрабатывают данные оптом, а не поэлементно в реальном времени. Batch Processing vs Stream Processing Существует два основных способа обработки данных: Batch Processing: обработка данных через предопределенные интервалы времени (hourly, daily, weekly). Охватывает примерно 80% задач в data engineering. Stream Processing: обработка данных в режиме реального времени по мере их поступления. Составляет около 20% задач в data engineering. Характеристика Batch Processing Stream Processing Режим обработки Через фиксированные интервалы Real-time Use cases Крупномасштабный ETL, отчетность, обучение ML-моделей Fraud detection, live dashboards, real-time рекомендации Типичные инструменты Apache Spark, SQL, Python-скрипты Apache Kafka, Apache Flink, Spark Streaming Примеры batch и stream обработки Batch Processing: обработка ежедневных данных о продажах в retail-магазине в полночь. Stream Processing: мониторинг цен на фондовом рынке в реальном времени с мгновенным обновлением dashboards. 2. Зачем использовать Batch Processing? Преимущества Batch Processing Простота управления: jobs выполняются по расписанию и могут быть перезапущены в случае сбоя. Эффективность для больших датасетов: структурированная обработка масштабных объемов данных. Cost-эффективность: обычно дешевле, чем real-time processing, так как ресурсы выделяются только по необходимости. Масштабируемость: легко масштабируется за счет увеличения compute resources. Недостатки Batch Processing Задержка в доступности данных: обработанные данные доступны только после завершения batch job. Resource-intensive: крупные batch-задания могут требовать значительных вычислительных ресурсов. Менее подходит для real-time applications: не оптимален для сценариев, требующих мгновенного получения insights. 3. Инструменты для Batch Processing Для пакетной обработки используется несколько инструментов и технологий: Python-скрипты: часто применяются для простых batch-заданий (например, чтение CSV-файла и загрузка в базу данных). SQL: используется для batch-трансформаций данных (например, агрегации sales data в базе данных). Apache Spark: мощный фреймворк для distributed computing и масштабной обработки данных. Apache Flink: еще одна distributed система, но преимущественно используемая для stream processing. Airflow: инструмент workflow orchestration для управления выполнением batch-заданий. 4. Введение в Apache Spark Apache Spark — один из самых популярных инструментов для batch processing благодаря своей скорости, масштабируемости и поддержке различных языков программирования. Ключевые характеристики Spark Distributed processing: использование нескольких машин для эффективной обработки данных. Multi-language support: может использоваться с Python (PySpark), Scala, Java и R. Resilient Distributed Datasets (RDD): фундаментальная структура данных в Spark для fault-tolerant processing. DataFrames и SQL: обеспечивает SQL-подобные запросы и обработку данных. Установка Spark Чтобы установить Spark на Linux VM в Google Cloud Platform: Создайте VM instance в Google Cloud. Установите Java (требуется для Spark). Загрузите и распакуйте Apache Spark. Настройте environment variables. Начните использовать Spark через PySpark. 5. Компоненты Spark Resilient Distributed Datasets (RDD) Low-level API для distributed data processing. Обеспечивает fault tolerance и parallel computation. DataFrames Более высокоуровневая абстракция, чем RDD. Аналогично SQL-таблицам, позволяет структурированно манипулировать данными. Spark SQL Позволяет запрашивать данные с использованием SQL-синтаксиса. Оптимизирован для performance с помощью Catalyst Optimizer. Spark Jobs и DAG (Directed Acyclic Graphs) Spark Job состоит из нескольких tasks. Spark создает DAG для оптимизации execution. 6. Запуск Spark Jobs в Docker Docker позволяет запускать Spark в изолированной среде. Шаги: Установите Docker. Загрузите Spark Docker image. Запускайте Spark jobs внутри Docker-контейнеров. 7. Deployment Spark в облаке Spark можно развернуть на cloud-платформах, таких как AWS EMR, Google Dataproc или Azure Synapse Analytics. Интеграция с data warehouses, такими как BigQuery, Redshift и Snowflake. 8. Резюме Batch processing идеально подходит для крупномасштабных data transformations с фиксированными интервалами. Apache Spark — мощный инструмент для batch processing. DataFrames и SQL упрощают использование Spark. Airflow помогает оркестрировать batch workflows. Cloud platfor

1. Введение в пакетную обработку (Batch Processing)

Что такое пакетная обработка?

Пакетная обработка (Batch Processing) — это метод обработки данных большими порциями в запланированные интервалы времени. Этот подход широко применяется в data engineering для эффективной обработки больших объемов данных. Batch-задания обрабатывают данные оптом, а не поэлементно в реальном времени.

Batch Processing vs Stream Processing

Существует два основных способа обработки данных:

- Batch Processing: обработка данных через предопределенные интервалы времени (hourly, daily, weekly). Охватывает примерно 80% задач в data engineering.

- Stream Processing: обработка данных в режиме реального времени по мере их поступления. Составляет около 20% задач в data engineering.

| Характеристика | Batch Processing | Stream Processing |

|---|---|---|

| Режим обработки | Через фиксированные интервалы | Real-time |

| Use cases | Крупномасштабный ETL, отчетность, обучение ML-моделей | Fraud detection, live dashboards, real-time рекомендации |

| Типичные инструменты | Apache Spark, SQL, Python-скрипты | Apache Kafka, Apache Flink, Spark Streaming |

Примеры batch и stream обработки

- Batch Processing: обработка ежедневных данных о продажах в retail-магазине в полночь.

- Stream Processing: мониторинг цен на фондовом рынке в реальном времени с мгновенным обновлением dashboards.

2. Зачем использовать Batch Processing?

Преимущества Batch Processing

- Простота управления: jobs выполняются по расписанию и могут быть перезапущены в случае сбоя.

- Эффективность для больших датасетов: структурированная обработка масштабных объемов данных.

- Cost-эффективность: обычно дешевле, чем real-time processing, так как ресурсы выделяются только по необходимости.

- Масштабируемость: легко масштабируется за счет увеличения compute resources.

Недостатки Batch Processing

- Задержка в доступности данных: обработанные данные доступны только после завершения batch job.

- Resource-intensive: крупные batch-задания могут требовать значительных вычислительных ресурсов.

- Менее подходит для real-time applications: не оптимален для сценариев, требующих мгновенного получения insights.

3. Инструменты для Batch Processing

Для пакетной обработки используется несколько инструментов и технологий:

- Python-скрипты: часто применяются для простых batch-заданий (например, чтение CSV-файла и загрузка в базу данных).

- SQL: используется для batch-трансформаций данных (например, агрегации sales data в базе данных).

- Apache Spark: мощный фреймворк для distributed computing и масштабной обработки данных.

- Apache Flink: еще одна distributed система, но преимущественно используемая для stream processing.

- Airflow: инструмент workflow orchestration для управления выполнением batch-заданий.

4. Введение в Apache Spark

Apache Spark — один из самых популярных инструментов для batch processing благодаря своей скорости, масштабируемости и поддержке различных языков программирования.

Ключевые характеристики Spark

- Distributed processing: использование нескольких машин для эффективной обработки данных.

- Multi-language support: может использоваться с Python (PySpark), Scala, Java и R.

- Resilient Distributed Datasets (RDD): фундаментальная структура данных в Spark для fault-tolerant processing.

- DataFrames и SQL: обеспечивает SQL-подобные запросы и обработку данных.

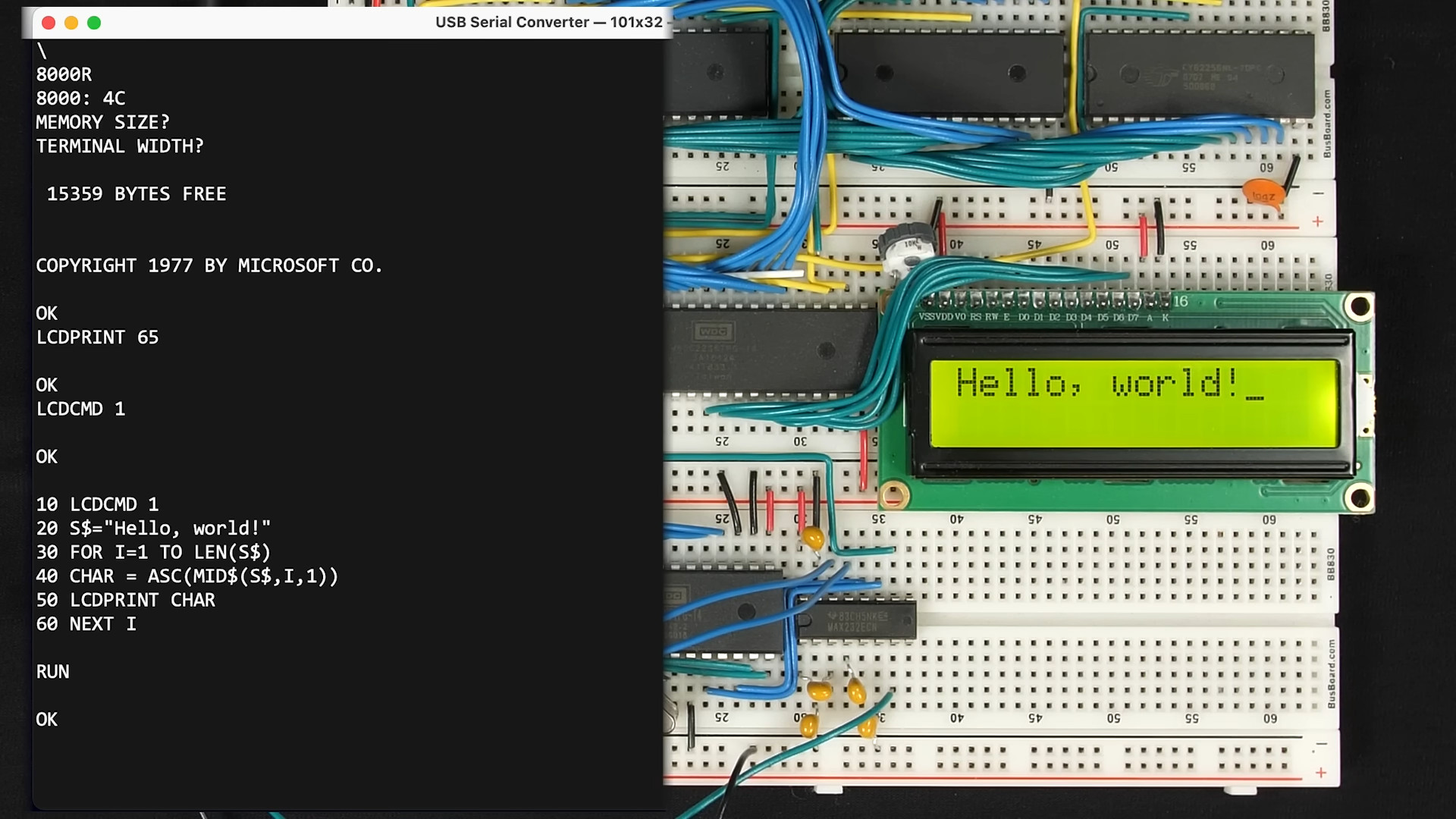

Установка Spark

Чтобы установить Spark на Linux VM в Google Cloud Platform:

- Создайте VM instance в Google Cloud.

- Установите Java (требуется для Spark).

- Загрузите и распакуйте Apache Spark.

- Настройте environment variables.

- Начните использовать Spark через PySpark.

5. Компоненты Spark

-

Resilient Distributed Datasets (RDD)

- Low-level API для distributed data processing.

- Обеспечивает fault tolerance и parallel computation.

-

DataFrames

- Более высокоуровневая абстракция, чем RDD.

- Аналогично SQL-таблицам, позволяет структурированно манипулировать данными.

-

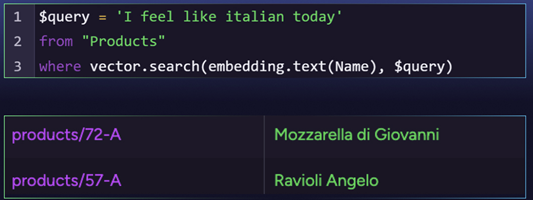

Spark SQL

- Позволяет запрашивать данные с использованием SQL-синтаксиса.

- Оптимизирован для performance с помощью Catalyst Optimizer.

-

Spark Jobs и DAG (Directed Acyclic Graphs)

- Spark Job состоит из нескольких tasks.

- Spark создает DAG для оптимизации execution.

6. Запуск Spark Jobs в Docker

Docker позволяет запускать Spark в изолированной среде.

Шаги:

- Установите Docker.

- Загрузите Spark Docker image.

- Запускайте Spark jobs внутри Docker-контейнеров.

7. Deployment Spark в облаке

Spark можно развернуть на cloud-платформах, таких как AWS EMR, Google Dataproc или Azure Synapse Analytics.

Интеграция с data warehouses, такими как BigQuery, Redshift и Snowflake.

8. Резюме

- Batch processing идеально подходит для крупномасштабных data transformations с фиксированными интервалами.

- Apache Spark — мощный инструмент для batch processing.

- DataFrames и SQL упрощают использование Spark.

- Airflow помогает оркестрировать batch workflows.

- Cloud platforms предоставляют scalable deployment options для Spark.

9. Дальнейшие шаги

- Попрактикуйтесь в выполнении Spark jobs с использованием PySpark.

- Изучите использование Airflow для scheduling batch jobs.

- Узнайте больше о stream processing на 6-й неделе.

1. Введение в Apache Spark

Определение:

Apache Spark — это unified, distributed engine для масштабной обработки данных. Он предназначен для поддержки задач по data engineering, data science и machine learning.

Основные характеристики:

- Distributed processing: Spark может обрабатывать данные в кластерах из множества машин, что делает его пригодным для больших датасетов.

- In-memory computing: способность кэшировать данные в памяти ускоряет iterative algorithms, особенно в машинном обучении.

- Multi-language support: хотя Spark написан на Scala, он предоставляет API для Python (PySpark), Java и R.

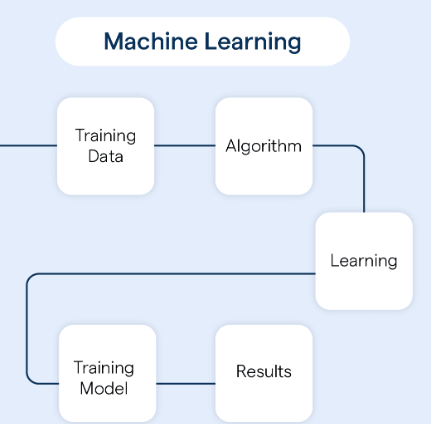

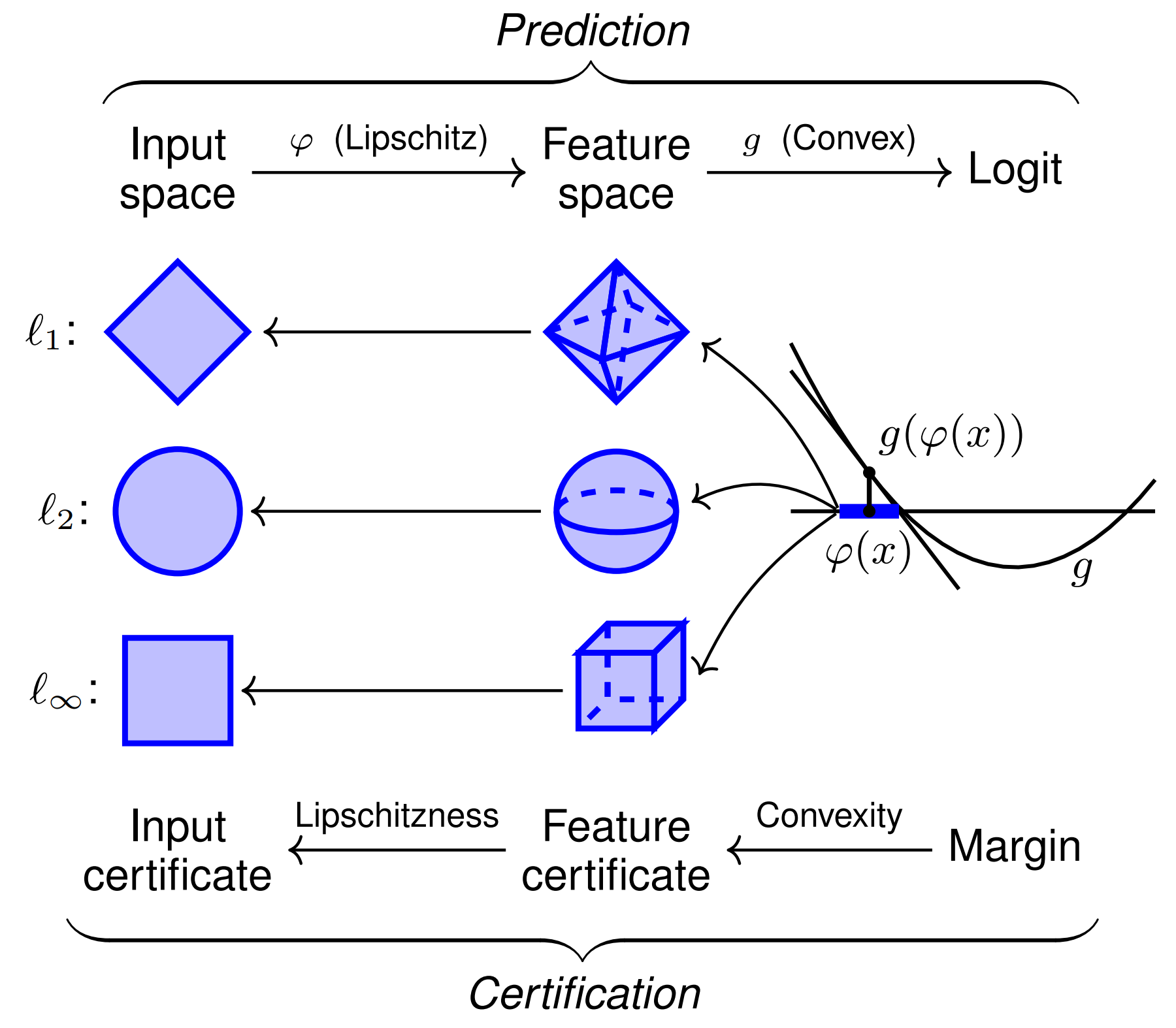

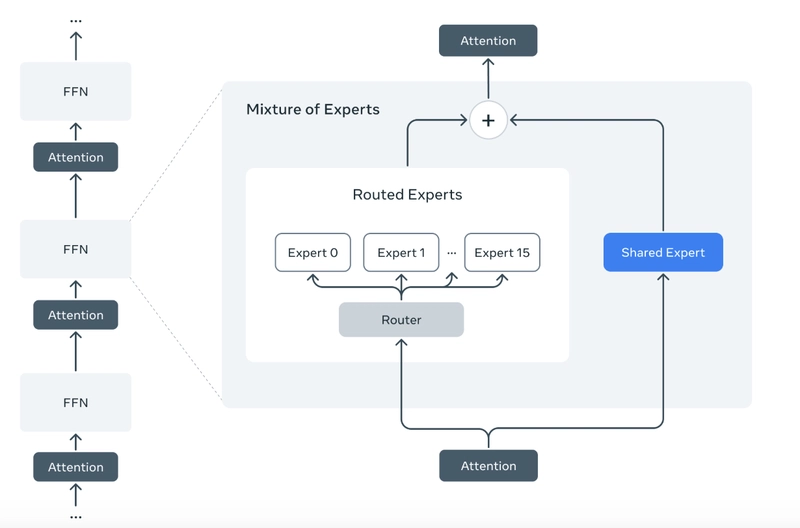

2. Основные концепции и архитектура

Spark Engine

Роль: Действует как центральный процессор, который:

- Извлекает данные из источников (например, data lakes, databases).

- Распределяет вычисления по многим nodes.

- Выводит обработанные данные обратно в target (data lake, warehouse и т.д.).

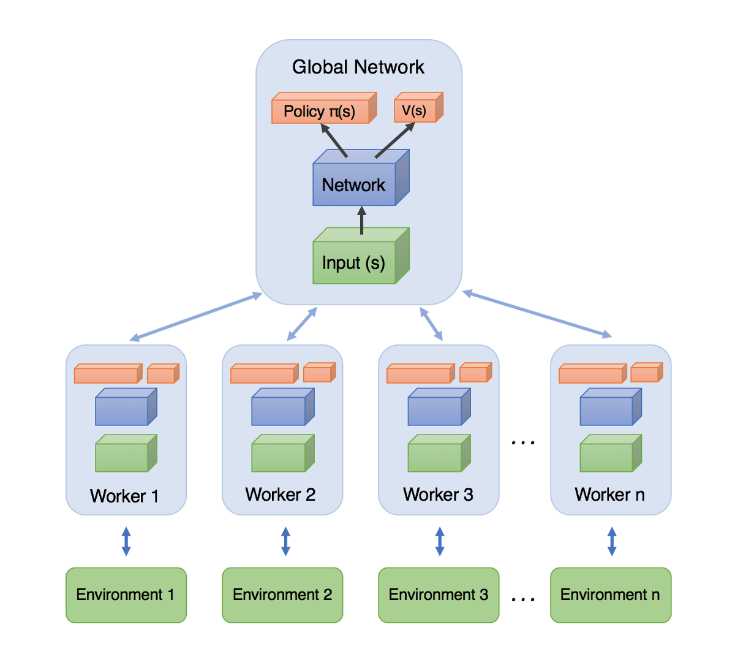

Компоненты кластера

- Driver: координирует выполнение Spark jobs, разбивая их на tasks и планируя их.

- Executors: worker-процессы, работающие на каждом node кластера, которые выполняют tasks на partitions данных.

- Cluster Manager: управляет resource allocation между applications (может быть YARN, Mesos, Kubernetes или Spark Standalone Manager).

Абстракции данных

- Resilient Distributed Datasets (RDD): фундаментальная структура данных, представляющая immutable, partitioned collections, которые можно обрабатывать параллельно.

- DataFrames и Datasets: высокоуровневые абстракции, построенные поверх RDD, которые позволяют выполнять structured operations (аналогично SQL-таблицам) и используют преимущества optimizations, таких как Catalyst Optimizer.

3. Компоненты экосистемы Spark

- Spark Core: обеспечивает базовые функции task scheduling, memory management, fault recovery и взаимодействия с storage systems.

- Spark SQL: позволяет запрашивать structured data через SQL и DataFrame API.

- MLlib: библиотека scalable machine learning алгоритмов.

- GraphX: предоставляет API для graph processing и analytics.

- Spark Streaming / Structured Streaming: обеспечивает real-time stream processing, рассматривая их как sequence of small batch jobs.

4. Language Support и программирование

- Scala: native language Spark, идеальный для performance-critical applications.

- Python (PySpark): самый популярный интерфейс благодаря простоте и богатой экосистеме libraries для data manipulation.

- Java и R: доступные альтернативы, хотя и менее распространенные для типичных data engineering задач во многих компаниях.

5. Use Cases и когда использовать Spark

Когда использовать Spark:

- Data Lake Processing: когда ваши данные находятся в file storage systems (например, S3 или Google Cloud Storage) и вам необходимо выполнить complex processing.

- Complex Transformations за пределами SQL: если логика job слишком сложна для SQL или требует modular programming и extensive testing.

- Machine Learning Workflows: для training и applying ML-моделей, где требуется flexibility, которую не может обеспечить только SQL.

- Streaming Data (advanced use): хотя в данной статье это подробно не рассматривается, Spark может обрабатывать streaming data, рассматривая streams как micro-batches.

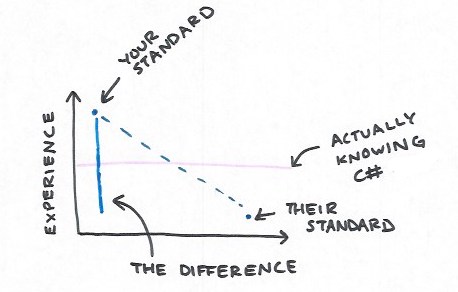

SQL против Spark:

-

SQL-based tools (например, Athena, Presto, BigQuery):

- Идеально, если ваша обработка может быть полностью выражена с помощью SQL.

- Лучше всего подходит для structured data в data warehouses или при использовании external tables в data lakes.

-

Apache Spark:

- Предпочтительно, когда нужна дополнительная flexibility для complex workflows.

- Полезно для комбинирования ETL-задач с machine learning или другими non-SQL операциями.

6. Типичный Data Engineering Workflow с использованием Spark

-

Data Ingestion:

- Raw data загружается в data lake.

-

Initial Transformations:

- Простые aggregations и joins можно выполнять с помощью SQL-based tools.

- Примеры инструментов: Athena, Presto или BigQuery.

-

Advanced Processing:

- Когда transformations слишком сложны для SQL, применяются Spark jobs (с использованием PySpark или Scala).

- На этом этапе часто решаются ML-задачи, такие как model training.

-

Model Application:

- Trained models можно применять к новым данным с помощью последующих Spark jobs.

- Результаты обычно записываются обратно в data lake или отправляются в data warehouse для дальнейшего анализа.

7. Преимущества использования Spark

- Scalability: эффективная обработка огромных объемов данных за счет distributed computing.

- Performance: in-memory processing и optimized execution plans (с помощью Catalyst и Tungsten) значительно повышают скорость.

- Flexibility: поддерживает различные workloads (batch, streaming, ML) и интегрируется со многими data sources.

- Extensibility: обеспечивает robust ecosystem для построения end-to-end data pipelines.

8. Начало работы с Apache Spark

Local setup:

- Installation: Начните с локальной установки Spark, чтобы поэкспериментировать с его функциями и API.

- Development tools: используйте interactive notebooks (например, Jupyter) или IDEs, поддерживающие Python или Scala.

Learning resources:

- Official documentation: сайт Apache Spark предлагает подробные tutorials и API reference.

- Online courses: курсы, такие как DE Zoomcamp, предлагают structured learning path от beginner до advanced level.

- Community и educational materials: участвуйте в online forums, посещайте webinars и изучайте hands-on examples для углубления знаний.

9. Advanced информация для опытных пользователей

Оптимизации:

- Изучите caching, partitioning strategies и tuning Spark configurations.

- Исследуйте advanced optimization techniques с помощью Spark Catalyst Optimizer.

Deployment:

- Поймите, как deploy Spark applications на различных cluster managers (например, YARN, Kubernetes) в production environments.

Интеграция:

- Интегрируйте Spark с другими big data tools и cloud platforms, изучая best practices для создания scalable, fault-tolerant data pipelines.

Evolving workloads:

- Следите за evolving features Spark (таких как Structured Streaming) для обработки как batch, так и real-time data.

Заключение

Apache Spark — это powerful tool, который заполняет gap между simple SQL-based transformations и complex processing requirements современного data engineering. Освоив его core components, поняв его ecosystem и зная, когда использовать его вместо традиционных SQL-решений, вы можете создавать scalable и efficient data pipelines. Эта статья предоставляет basic framework, который в сочетании с hands-on practice и further learning поддержит ваш journey от новичка до professional data engineer.

![[The AI Show Episode 142]: ChatGPT’s New Image Generator, Studio Ghibli Craze and Backlash, Gemini 2.5, OpenAI Academy, 4o Updates, Vibe Marketing & xAI Acquires X](https://www.marketingaiinstitute.com/hubfs/ep%20142%20cover.png)

![[FREE EBOOKS] The Kubernetes Bible, The Ultimate Linux Shell Scripting Guide & Four More Best Selling Titles](https://www.javacodegeeks.com/wp-content/uploads/2012/12/jcg-logo.jpg)

![From drop-out to software architect with Jason Lengstorf [Podcast #167]](https://cdn.hashnode.com/res/hashnode/image/upload/v1743796461357/f3d19cd7-e6f5-4d7c-8bfc-eb974bc8da68.png?#)

.png?#)

.jpg?#)

_Christophe_Coat_Alamy.jpg?#)

(1).webp?#)

![Rapidus in Talks With Apple as It Accelerates Toward 2nm Chip Production [Report]](https://www.iclarified.com/images/news/96937/96937/96937-640.jpg)