Big-O en Español Parte 5

En los artículos anteriores sobre la notación Big-O, exploramos diversas complejidades, desde constantes y lineales hasta factoriales y exponenciales. Sin embargo, hay muchas otras consideraciones importantes cuando se trata de analizar y optimizar algoritmos. En este artículo, abordaremos temas avanzados que complementan los conceptos básicos de Big-O. ¿Qué encontrarás en esta serie? Parte 1: Expresiones Lineales y Constantes Introducción a las notaciones más simples y cómo afectan el rendimiento de nuestros algoritmos. Parte 2: Expresiones Cuadráticas, Cúbicas y de Otras Potencias Un análisis más profundo sobre cómo crecen los tiempos de ejecución en algoritmos más complejos. Parte 3: Expresiones Logarítmicas, Exponenciales y Factoriales Exploraremos casos donde el tiempo de ejecución crece de forma mucho más drástica. Parte 4: Combinando Complejidades y Comparando Estructuras de Datos Analizaremos cómo diferentes estructuras de datos afectan la complejidad y cómo combinar varios algoritmos. Parte 5: Consideraciones Avanzadas y Casos Reales Reflexiones finales sobre trade-offs entre tiempo y espacio, complejidades amortizadas, y cómo aplicar Big-O en escenarios reales. Consideraciones Adicionales en Big-O 1. Complejidad Espacial (Space Complexity) Además de medir el tiempo de ejecución de un algoritmo, también es fundamental considerar la complejidad espacial, que mide cuánta memoria adicional requiere un algoritmo mientras se ejecuta. Ejemplo: Espacial constante (O(1)): No se necesita memoria adicional que dependa del tamaño de los datos de entrada. Espacial lineal (O(n)): Requiere memoria proporcional al tamaño de los datos de entrada. function calcularSuma(arreglo) { let suma = 0; // Espacial constante for (let i = 0; i

En los artículos anteriores sobre la notación Big-O, exploramos diversas complejidades, desde constantes y lineales hasta factoriales y exponenciales. Sin embargo, hay muchas otras consideraciones importantes cuando se trata de analizar y optimizar algoritmos.

En este artículo, abordaremos temas avanzados que complementan los conceptos básicos de Big-O.

¿Qué encontrarás en esta serie?

Parte 1: Expresiones Lineales y Constantes

Introducción a las notaciones más simples y cómo afectan el rendimiento de nuestros algoritmos.Parte 2: Expresiones Cuadráticas, Cúbicas y de Otras Potencias

Un análisis más profundo sobre cómo crecen los tiempos de ejecución en algoritmos más complejos.Parte 3: Expresiones Logarítmicas, Exponenciales y Factoriales

Exploraremos casos donde el tiempo de ejecución crece de forma mucho más drástica.Parte 4: Combinando Complejidades y Comparando Estructuras de Datos

Analizaremos cómo diferentes estructuras de datos afectan la complejidad y cómo combinar varios algoritmos.Parte 5: Consideraciones Avanzadas y Casos Reales

Reflexiones finales sobre trade-offs entre tiempo y espacio, complejidades amortizadas, y cómo aplicar Big-O en escenarios reales.

Consideraciones Adicionales en Big-O

1. Complejidad Espacial (Space Complexity)

Además de medir el tiempo de ejecución de un algoritmo, también es fundamental considerar la complejidad espacial, que mide cuánta memoria adicional requiere un algoritmo mientras se ejecuta.

Ejemplo:

- Espacial constante (O(1)): No se necesita memoria adicional que dependa del tamaño de los datos de entrada.

- Espacial lineal (O(n)): Requiere memoria proporcional al tamaño de los datos de entrada.

function calcularSuma(arreglo) {

let suma = 0; // Espacial constante

for (let i = 0; i < arreglo.length; i++) {

suma += arreglo[i]; // Solo usamos una variable adicional para almacenar la suma

}

return suma;

}

En este caso, la complejidad espacial es O(1), ya que no se crean estructuras adicionales proporcionales al tamaño de los datos.

2. Trade-off entre Tiempo y Espacio

En muchos casos, optimizar el tiempo de ejecución de un algoritmo puede incrementar su complejidad espacial, y viceversa. Este equilibrio debe analizarse en función de los recursos disponibles.

Ejemplo: Almacenamiento en caché (memoization)

function fibonacci(n, memo = {}) {

if (n <= 1) return n;

if (memo[n]) return memo[n]; // Uso de memoria adicional

memo[n] = fibonacci(n - 1, memo) + fibonacci(n - 2, memo);

return memo[n];

}

Este enfoque mejora el tiempo de ejecución al reducir llamadas redundantes, pero utiliza memoria adicional para almacenar los resultados.

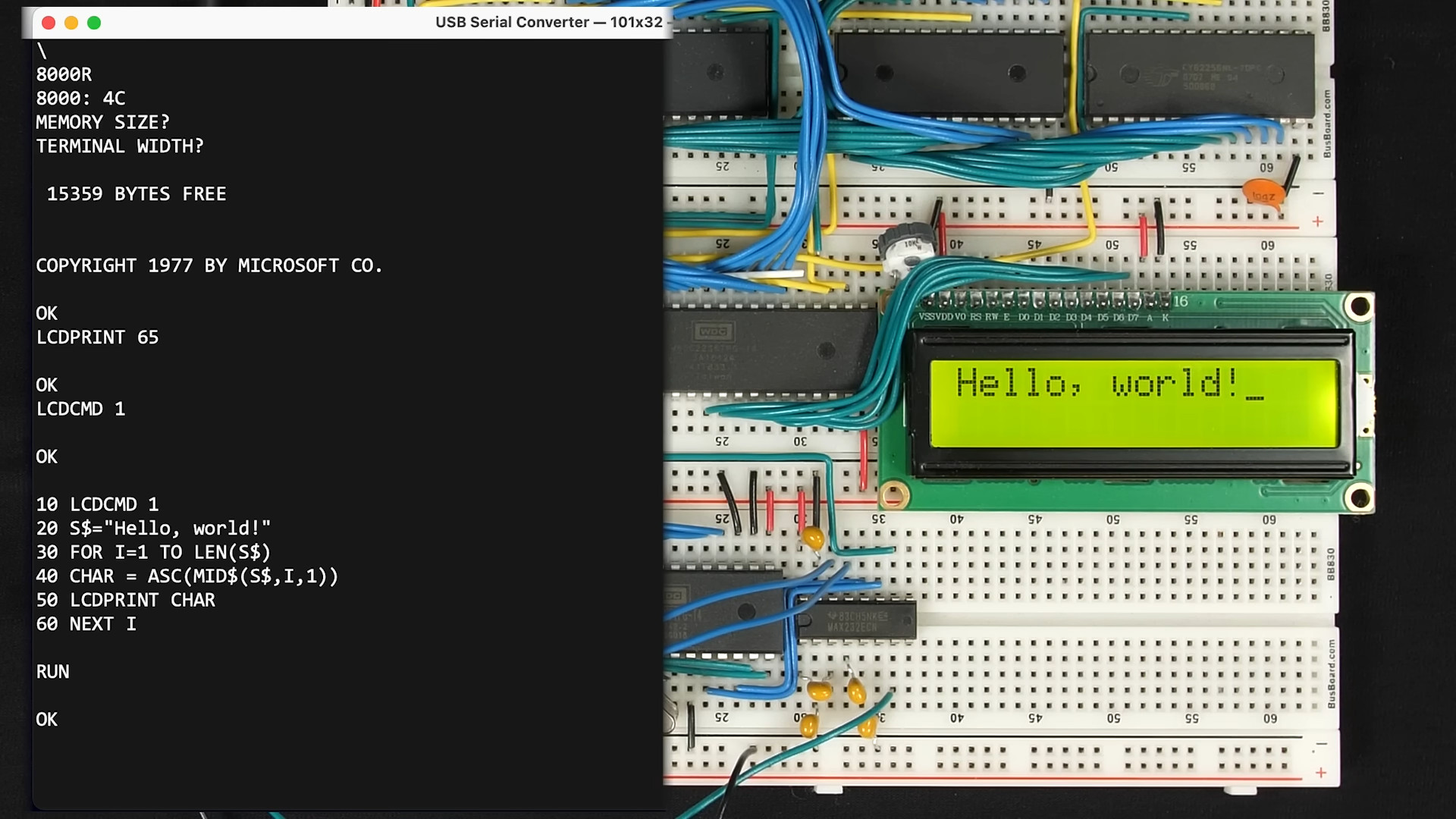

3. Complejidad Amortizada

La complejidad amortizada evalúa el costo promedio de una operación en un conjunto de datos después de realizar varias operaciones.

Ejemplo: Arrays Dinámicos

Los arreglos dinámicos, como los de JavaScript, duplican su tamaño cuando se excede su capacidad. Aunque la inserción parece O(n) al duplicarse, la complejidad promedio es O(1) debido a la rareza de esta operación de redimensionamiento.

let arreglo = [];

arreglo.push(1); // O(1)

arreglo.push(2); // O(1)

arreglo.push(3); // Si se excede la capacidad, se copia en un arreglo más grande (O(n))

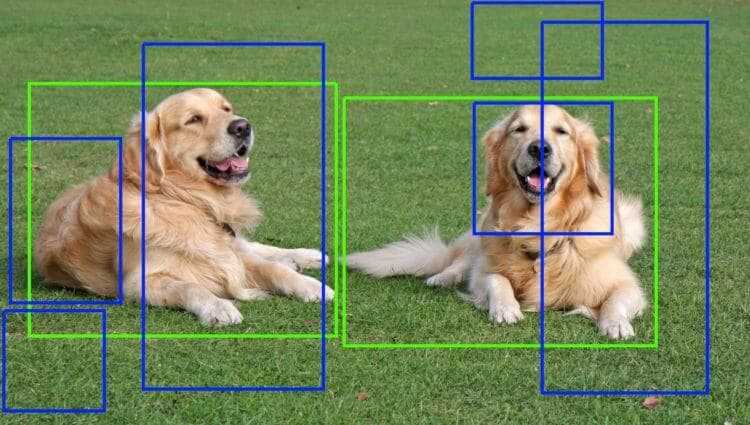

4. Casos Especiales: Mejor, Peor y Promedio Caso

El análisis de Big-O puede variar según los datos de entrada. Es importante entender los tres casos:

- Mejor caso: El tiempo mínimo que toma un algoritmo. Ejemplo: Buscar un elemento que está al inicio de un arreglo.

- Peor caso: El tiempo máximo que toma un algoritmo. Ejemplo: Buscar un elemento que no está en un arreglo.

- Caso promedio: Tiempo promedio considerando datos de entrada aleatorios.

Ejemplo: Búsqueda lineal

function buscarElemento(arreglo, elemento) {

for (let i = 0; i < arreglo.length; i++) {

if (arreglo[i] === elemento) return i; // Mejor caso: O(1)

}

return -1; // Peor caso: O(n)

}

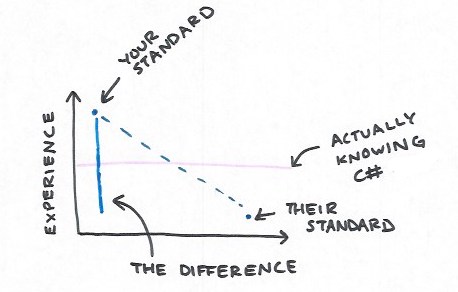

5. Impacto de la Constante Oculta

La notación Big-O ignora las constantes y los términos de menor grado, pero en la práctica, estas constantes pueden tener un impacto significativo.

Ejemplo: Algoritmo Bubble Sort vs Quick Sort

Aunque ambos algoritmos tienen la misma complejidad en el peor caso (O(n²)), Quick Sort es mucho más eficiente en promedio debido a su menor constante oculta.

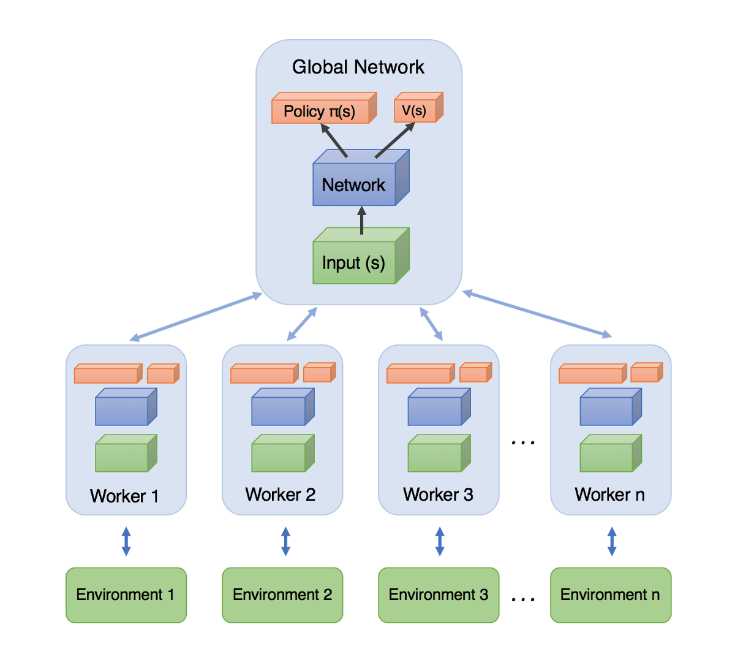

6. Paralelismo y Concurrencia

En sistemas modernos, el paralelismo y la concurrencia pueden reducir significativamente el tiempo de ejecución, aunque no cambian la notación Big-O.

Ejemplo: Procesamiento en paralelo

Si un algoritmo procesa datos en paralelo, su tiempo de ejecución puede dividirse entre el número de hilos o procesadores.

function procesarDatosEnParalelo(datos) {

const resultados = datos.map(dato => procesar(dato)); // Operación paralela en sistemas distribuidos

return resultados;

}

Conclusión

Big-O es una herramienta esencial para entender la eficiencia de los algoritmos, pero no es el único factor a considerar. Complejidades espaciales, análisis de casos especiales, constantes ocultas y el impacto del paralelismo son aspectos importantes que complementan el análisis de eficiencia.

Con estos conceptos avanzados, puedes analizar algoritmos de manera más profunda y tomar decisiones informadas al diseñar soluciones escalables.

![[The AI Show Episode 142]: ChatGPT’s New Image Generator, Studio Ghibli Craze and Backlash, Gemini 2.5, OpenAI Academy, 4o Updates, Vibe Marketing & xAI Acquires X](https://www.marketingaiinstitute.com/hubfs/ep%20142%20cover.png)

![[FREE EBOOKS] The Kubernetes Bible, The Ultimate Linux Shell Scripting Guide & Four More Best Selling Titles](https://www.javacodegeeks.com/wp-content/uploads/2012/12/jcg-logo.jpg)

![From drop-out to software architect with Jason Lengstorf [Podcast #167]](https://cdn.hashnode.com/res/hashnode/image/upload/v1743796461357/f3d19cd7-e6f5-4d7c-8bfc-eb974bc8da68.png?#)

.png?#)

.jpg?#)

_Christophe_Coat_Alamy.jpg?#)

![Rapidus in Talks With Apple as It Accelerates Toward 2nm Chip Production [Report]](https://www.iclarified.com/images/news/96937/96937/96937-640.jpg)